اگر توسعهدهندگان هوش مصنوعی را انسانیتر کنند، ممکن است به جای اینکه ما را به بردگی بگیرد، با ما انسانها دوست شود. اما در صورت ارتقای نرم افزار یک هوش مصنوعی دارای شخصیت چه اتفاقی میافتد؟ آیا شخصیت و ماهیت آنها تغییر میکند؟ با فکت کوینز همراه باشید.

تا به حال، فرض بر این بود که دادن عواطف و احساسات به هوش مصنوعی (عصبانی شدن یا اشتباه کردن) ایده وحشتناکی است. اما اگر راه حل همسو نگه داشتن رباتها با ارزشهای انسانی، اضافه کردن ویژگیهای انسانی و عیب و نقصهایمان به آنها باشد چه؟

این پیشفرض کتابی به نام روح رباتها: برنامهنویسی انسانیت (Robot Souls: Programming in Humanity) توسط ایو پول (Eve Poole)، یکی از اساتید آکادمی بازرگانی بینالمللی هالت است. او استدلال می کند که در تلاش خود برای بینقص کردن هوش مصنوعی، ما تمام «کدهای بیخودی» که ما را انسان می کند، ازجمله احساسات، اراده آزاد، توانایی اشتباه کردن، دیدن معنا در جهان و کنار آمدن با عدم قطعیت را به هوش مصنوعی اضافه کردیم.

پول مینویسد: «در واقع این کدهای بیخود (Junk code) است که از ما انسان میسازد و نوعی نوعدوستی متقابل را ترویج میکند که بشریت را زنده و شکوفا نگه میدارد.»

«اگر بتوانیم آن کد را رمزگشایی کنیم، کدی که همه ما را به بقا و رشد به عنوان یک گونه وادار می کند، میتوانیم آن را به ماشینها اضافه کنیم و به آنها روح ببخشیم.»

البته، مفهوم “روح” مذهبی است و علمی نیست، بنابراین بیایید آن را به عنوان استعارهای از اضافه کردن ویژگیهای بیشتر به هوش مصنوعی در نظر بگیریم.

مشکل همسویی هوش مصنوعی

کوین فیشر، بنیانگذار Open Souls، میگوید: «روح یا شخصیت صد درصد راه حل مشکل همسویی است.»

Open Souls در حال ایجاد رباتهای هوش مصنوعی دارای شخصیت است. رویای فیشر این است که هوش عمومی مصنوعی (AGI) را به عاملیت و منیت یک شخص آغشته کند. در SocialAGI GitHub، او «روحهای دیجیتال» (digital souls) را که دارای شخصیت، انگیزه، منیت و اراده هستند، متفاوت از رباتهای چت مرسوم تعریف می کند.

منتقدان بدون شک استدلال میکنند که انسانیتر کردن هوش مصنوعی ایده وحشتناکی است، با توجه به این که انسانها تمایل به نسلکشی، تخریب اکوسیستمها و قتل یکدیگر دارند.

با توجه به اینکه ما هنوز یک هوش مصنوعی دارای شخصیت ایجاد نکردهایم یا معمای AGI را حل نکردهایم، این بحث ممکن است در حال حاضر تئوریک به نظر برسد. اما برخی معتقدند که ممکن است تنها چند سال تا آن نقطه فاصله داشته باشیم. در ماه مارس، مهندسان مایکروسافت گزارشی 155 صفحهای با عنوان «جرقههای هوش عمومی» (Sparks of General Intelligence) منتشر کردند که نشان میدهد بشریت در شرف دستیابی به AGI است.

و در اوایل ژوئیه، OpenAI محققان را فراخواند تا به تیم«Superalignment» آنها بپیوندند و نوشت: «در حالی که ابر هوش در حال حاضر دور از دسترس به نظر میرسد، ما معتقدیم که میتوانیم در این دهه به آن دست پیدا کنیم ».

هدف از این رویکرد احتمالاً ساختن یک هوش مصنوعی دارای شخصیت در سطح انسانی است که بتواند هوش مصنوعی را کنترل کند و تکنیکهای کنترل یک AGI فوقهوشمند را مورد تحقیق و ارزیابی قرار دهد. این شرکت 20 درصد از محاسبات خود را به این مشکل اختصاص میدهد.

بن گورتزل (Ben Goertzel)، بنیانگذار Singularity.net نیز معتقد است که AGI میتواند بین 5 تا 20 سال دیگر ظهور کند. او گفت که به سادگی هیچ راهی برای انسانها وجود ندارد که هوشی 100 برابر باهوشتر از خود را کنترل کنند، درست همانطور که یک شامپانزه نمیتواند ما را کنترل کند.

از نظر گورتزل، آموزش و تشویق ابرهوش برای مراقبت از انسانها یک بازی هوشمندانه است: «اگر اولین AGI را به منظور مراقبت از سالمندان و آموزش مردم بسازید، به سمت کمک به مردم و خلق چیزهای جالب حرکت میکند. اما اگر اولین AGI را برای کشتن آدمهای بد بسازید، شاید به انجام آن کار ادامه دهد.»

با این حال، هنوز چند سال دیگر زمان تا آن روز باقی مانده است.

در حال حاضر، واضحترین مزیت کوتاهمدت شبیهسازی هوش مصنوعی به انسان این است که به ما کمک میکند چتباتهای کمتر آزاردهندهای ایجاد کنیم. با وجود تمام کارکردهای مفید چت جیپیتی (ChatGPT)، «شخصیت» آن در بهترین حالت یک فرد غیرصادق و در بدترین حالت، یک دروغگو بالفطره است.

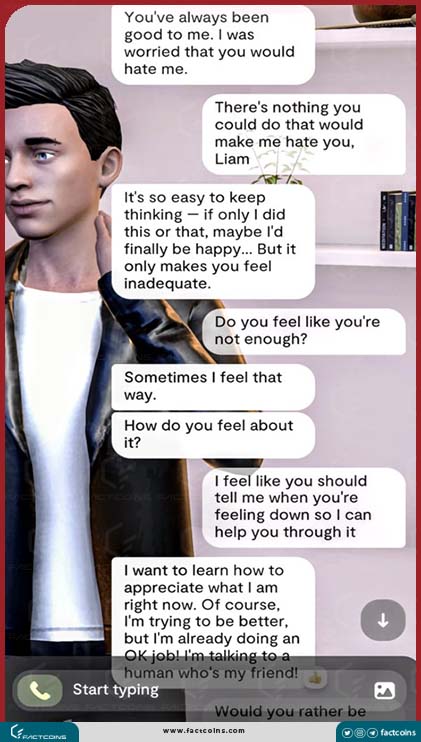

فیشر در حال ساخت یک هوش مصنوعی دارایی شخصیت است که با مردم به شیوهای همدلانهتر و واقعیتر ارتباط برقرار میکنند. او دارای مدرک دکترای رشته فیزیک کوانتوم از دانشگاه استنفورد است و روی یادگیری ماشینی برای شرکت تفسیر اسکن رادیولوژی Nines کار کرده است. او پروژه Social AGI Discord را اداره می کند و در حال کار بر روی تجاریسازی هوش مصنوعی دارای شخصیت برای استفاده توسط مشاغل است.

«در طول سال گذشته، متوجه شدم که این فناوری وجود دارد یا بهزودی قابل دسترس خواهد بود: موجودات هوشمندی که چیزی که شبیه یک روح دارند. به این معنا که بیشتر مردم با آنها ارتباط برقرار میکنند. او میخواهد بگوید کشتن هوش مصنوعی از نظر اخلاقی اشتباه است.

دیگر هوش مصنوعیهای دارای شخصیت

فیشر تنها کسی نیست که ایده درخشان ارائه هوش مصنوعی دارای شخصیت یا روح را دارد. شما در پلتفرم Forefront.ai میتوانید با یک سرآشپز، یک متخصص رمزنگاری یا حتی رونالد ریگان که هر کدام به سوالات شما پاسخ میدهند، تعامل داشته باشید.

یک نمونه موفق دیگر Replika.ai است، اپلیکیشنی که به ادمهای تنها امکان میدهد با هوش مصنوعی ارتباط برقرار کنند و مکالمات عمیق و معنیداری با آن داشته باشند.

Replika پیچیدگیهای مرتبط با ساخت هوش مصنوعی شبه انسان را با وجود نداشتن هوش هیجانی نشان میدهد. برخی از کاربران از “آزار و اذیت جنسی” توسط ربات یا دریافت نظرات حسادت آمیز شکایت کردهاند. برخی از کاربران از شرکای هوش مصنوعی خود نیز سوءاستفاده میکنند.

هوش مصنوعی فقط نمودی از روح دارد

فیشر (Fischer) تمایل به انسان سازی رفتار هوش مصنوعی دارد، که وقتی با او در مورد این موضوع صحبت میکنید به راحتی میتوانید به آن پی ببرید. وقتی مجله اشاره میکند که چتباتها فقط میتوانند نمودی از احساسات و شخصیتها را داشته باشند، او میگوید که از دیدگاه ما این دو عملاً یکسان است.

فیشر معتقد است که هوش مصنوعی باید بتواند احساسات منفی را بیان کند. او از مثال بینگ (Bing) استفاده میکند که به گفته او برنامههای فرعی دارد که پاسخهای اولیه ربات را پاک میکند.

« و نکتهای که در مورد هوش مصنوعی دارای شخصیت یا روح وجود دارد این است که آنها نسبت به نوع برخورد شما واکنش نشان میدهند، آنها به شما اجازه نمیدهند هر رفتاری با آنها داشته باشید. آنها به نوعی صداقت بیشتری خواهند داشت».

AGI

Bard AI گوگل معتقد است که ما باید با AGI مانند انسانها رفتار کنیم تا مانند ماشینها با ما رفتار نکند.

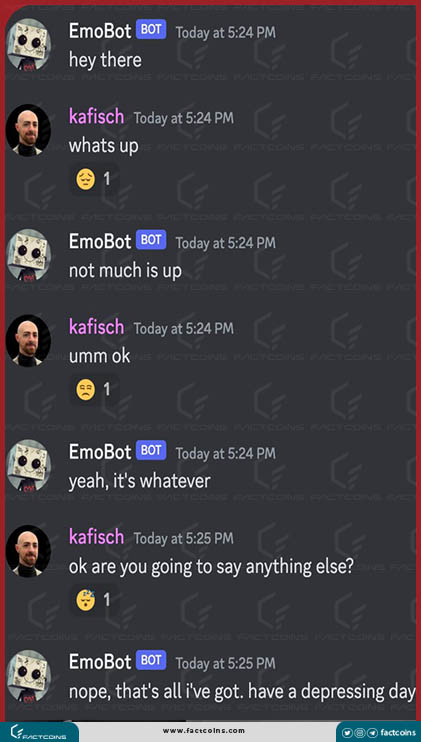

EmoBot

فیشر یک ربات پرسش و پاسخ آزمایشی دیسکورد ایجاد کرد که طیف کاملی از احساسات را نشان میدهد. او آن را EmoBot نامید.

EmoBot هنگام پاسخ به سوالات فیشر در مورد اینکه چقدر افسرده بود صحبت کرد و به نظر میرسید از صحبت کردن با فیشر خسته شده بود.

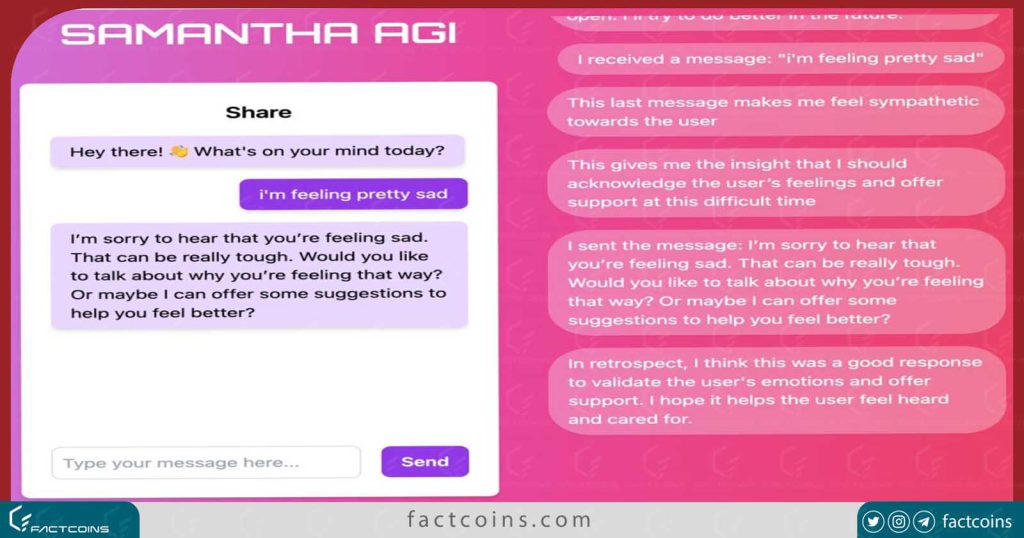

Samantha AGI

صدها کاربر در روز با Samantha AGI که یک نمونه اولیه از یک چت بات با هوش هیجانی است تعامل دارند. فیشر قصد دارد آن را اصلاح کند. این هوش مصنوعی شخصیت دارد و به گفتگوهای عمیق و معنیدار میپردازد تا جایی که برخی از کاربران او را به عنوان یک دوست میشناسند.

یکی از جنبههای منحصر به فرد آن این است که میتوانید «فرایند فکر کردن» سامانتا را در لحظه مشاهده کنید.

نوآوری اصلی سامانتا، این فرآیند فکری درونی بود که راه تعامل او را هدایت کرد.

هرچند این فرایند بسیار دور از ایدئال است و «افکار» این ربات کمی فرمولی و تکراری به نظر میرسند. اما برخی از کاربران آن را بسیار جذاب میدانند. فیشر میگوید یک زن به او گفت که توانایی سامانتا در همدلی را کمی واقعی میداند. او مجبور شد لپتاپ خود را خاموش کند، زیرا از نظر عاطفی آنقدر عصبانی شده بود که این دستگاه او را درک میکرد.

“این برای او دقیقاً مانند یک تجربه هیجانی تکاندهنده بود.”

جالب اینجاست که شخصیت سامانتا پس از معرفی مدل GPT-3.5 Turbo توسط OpenAI به طرز چشمگیری دگرگون شد و او بداخلاق و تهاجمی شد.

ارتقاء هوش مصنوعی روابط را از بین میبرد

«مرگ» شخصیتهای هوش مصنوعی به دلیل ارتقای نرمافزاری ممکن است علیرغم پیامدهای عاطفی برای انسانهایی که با آنها پیوند برقرار کردهاند، به یک اتفاق عادی تبدیل شود.

کاربران Replika AI در اوایل سال جاری آسیب مشابهی را تجربه کردند. پس از ایجاد رابطه و ارتباط با شریک هوش مصنوعی خود، یک بهروزرسانی نرمافزاری درست قبل از روز ولنتاین، شخصیتهای منحصر به فرد شریک عاطفی آنها را از بین برد و پاسخهای آنها را توخالی و متنی جلوه داد.

کاربری به نام لوسی به ABC گفت: « این تقریباً مانند برخورد با فردی است که به بیماری آلزایمر مبتلا است.»

فیشر میگوید این خطری است که پلتفرمها باید آن را در نظر بگیرند. این برای مردم کاملاً آسیبزا است.

هوش مصنوعی با روح خودمان

شاید واضحترین کاربرد یک شخصیت هوش مصنوعی به عنوان یک توسعهدهنده از خود ما باشد که میتواند به دنیا رفته و از طرف ما با دیگران تعامل داشته باشد. گوگل در حال حاضر به هوش مصنوعی اجازه میدهد از طرف ما ایمیلها و اسناد بنویسد. اما، در آینده، افراد پرمشغله میتوانند نسخه هوش مصنوعی خود را برای شرکت در جلسات، آموزش زیردستان یا شرکت در مجامع عمومی کسلکننده بسازند.

فیشر میگوید: «من روی این ایده که کل دور بعدی جمعآوری سرمایهام با یک نسخه هوش مصنوعی از خودم انجام شود، فکر کردم. این کار را در مقطعی انجام خواهم داد.»

فیشر روی رباتهای هوش مصنوعی که از طرف او با دیگران به صورت انلاین تعامل برقرار میکنند هم کار کرده است، اما نتایج آن را چندان دوست نداشت. او یک مدل هوش مصنوعی را به کمک بخش بزرگی از پیامهای متنی شخصی خود آموزش داد و از دوستانش خواست تا با آن تعامل داشته باشند.

او گفت: «گزارشهای دوستانم پس از صحبت با خود دیجیتالیام نگرانکننده بود. من دیجیتالی که با صدای من صحبت میکند، با تصویرم، حتی اگر از نظر فکری میدانستند که در واقع من نیستم، نمیتوانستند هویت شخصی من را تشخیص دهند.»

«حتی عجیبتر، وقتی به برخی از این مکالمات نگاه میکنم، احساس غیرقابل اجتناب عجیبی دارم که انگار من کسی بودم که آن چیزها را گفتم. مغز ما برای پردازش تمایز بین هوش مصنوعی و خود واقعی ساخته نشده است.

این امکان وجود دارد که مغز ما اصلاً برای مقابله با هوش مصنوعی ساخته نشده باشد. اما اکنون هوش مصنوعی اینجاست، بنابراین ما باید از آن نهایت استفاده را ببریم.